Rețea neurală

| Inteligență artificială |

|---|

|

| IA simbolică |

| Conecționism |

| Viață artificială |

| Metoda empirică Bayes |

| Sisteme Fuzzy |

| Filosofie |

| Glosar |

| Vezi și |

Rețelele neurale[1] (RN, în engleză: ANN de la artificial neural network) sunt o ramură din știința inteligenței artificiale, și constituie totodată, principial, un obiect de cercetare și pentru neuroinformatică. Rețelele neurale artificiale caracterizează ansambluri de elemente de procesare simple, puternic interconectate și operând în paralel, care urmăresc să interacționeze cu mediul înconjurător într-un mod asemănător creierelor biologice și care prezintă capacitatea de a învăța. Ele sunt compuse din neuroni artificiali, sunt parte a inteligenței artificiale și își au, concepțional, originea ca și neuronii artificiali, în biologie. Nu există pentru RNA o definiție general acceptată a acestor tipuri de sisteme, dar majoritatea cercetătorilor sunt de acord cu definirea rețelelor neurale artificiale ca rețele de elemente simple puternic interconectate prin intermediul unor legături numite interconexiuni prin care se propagă informație numerică.

Originea acestor rețele trebuie căutată în studierea rețelelor bioelectrice din creier formate de neuroni și sinapsele acestora. Principala trăsătură a acestor rețele este capacitatea de a învăța pe bază de exemple, folosindu-se de experiența anterioară pentru a-și îmbunătăți performanțele.

Structură

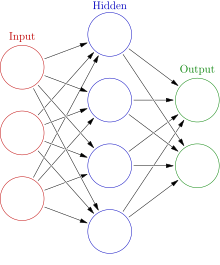

[modificare | modificare sursă]Deși se aseamănă în funcționare cu creierul uman, rețelele neurale au o structură diferită de cea a creierului. O rețea neurală este mult mai simplă decât corespondentul său uman, dar la fel ca și creierul uman, este compusă din unități puternice cu capacitate de calcul, mult inferioare însă corespondentului uman, neuronul.

Caracteristici

[modificare | modificare sursă]Rețelele neurale artificiale se pot caracteriza pe baza a 3 elemente:

- modelul adoptat pentru elementul de procesare individual,

- structura particulară de interconexiuni (arhitectura)

- mecanismele de ajustare a legăturilor (de învățare).

Modele ale neuronului artificial

[modificare | modificare sursă]Sunt mai multe criterii de clasificare a modelelor neuronului elementar, ce implică: domeniul de definiție a semnalelor folosite, natura datelor folosite, tipul funcției de activare, prezența memoriei. Dar cel mai utilizat model este modelul aditiv.

Arhitecturi

[modificare | modificare sursă]Există numeroase modalități de interconectare a neuronilor elementari, dar pot fi identificate două clase de arhitecturi:

- cu propagare a informației numai dinspre intrare spre ieșire, rețele de tip feedforward

- rețele recurente (cu reacție).

Un dezavantaj al rețelelor neurale îl constituie lipsa teoriei care să precizeze tipul rețelei și numărul de neuroni elementari, precum și modalitatea de interconectare. Există câteva tehnici de tip pruning sau de tip learn and grow, dar acestea sunt în intense cercetări.

Algoritmi de învățare

[modificare | modificare sursă]Principala deosebire a rețelelor neurale față de alte sisteme (electronice) de prelucrare a informațiilor îl constituie capacitatea de învățare în urma interacțiunii cu mediul înconjurător, și îmbunătățirii performanțelor. O reprezentare corectă a informațiilor, care să permită interpretarea, predicția și răspunsul la un stimul extern, poate permite rețelei să construiască un model propriu al procesului analizat. Acest model va putea răspunde astfel unor stimuli neutilizați în procesele anterioare de învățare ale rețelei RNA. Informațiile utilizate în procesul de învățare pot fi: informații disponibile a priori sau perechi intrare-ieșire(care stabilesc relații de tipul cauză-efect), iar modul de reprezentare internă urmărește un set de reguli bine documentate. Acești algoritmi pot fi clasificați după mai multe criterii cum ar fi: disponibilitatea răspunsului dorit la ieșirea rețelei, existența unui model analitic, tipul aplicației în care sunt utilizați, dar cele mai multe documentații se rezumă la două clase mari: învățarea supravegheată (care presupune existența în orice moment a unei valori dorite a fiecărui neuron din stratul de ieșire) și învățarea nesupravegheată (în care rețeaua extrage singură anumite caracteristici importante a datelor de ieșire, în urma unui gen de competiție între neuronii elementari). În ultima perioadă se remarcă încă o clasă de algoritmi, algoritmii de învățare folosind un critic, rezultați în urma observațiilor experimentale făcute pe animale, acestia fiind de tipul recompensă/pedeapsă.

Aplicații în viața de zi cu zi

[modificare | modificare sursă]Domeniile în care rețelele neurale realizează modele eficiente sunt :

- Aproximări de funcții

- Predicții ale unor serii temporale

- Clasificări

- Recunoaștere de tipare

- Recunoaștere vocală

- Scanarea retinei

- Învățarea robotului care se verifică în mod constant cu un om

Astfel de implementări ale rețelelor neurale, legate de sectorul bussines se întâlnesc în:

- previziuni financiare

- controlul proceselor industriale

- cercetări de piață

- validări de date pe bază de clasificări și de tipare

- management de risc

- previziuni de marketing

Rețele neurale folosind algoritmi genetici pot fi folosite în controlul roboților industriali. Un alt domeniu de interes pentru rețelele neurale este medicina și sistemele biomedicale. În acest moment se utilizează rețele neurale pentru descoperirea de boli, prin recunoașterea unor tipare de pe cardiograme, ș.a.

Istoric

[modificare | modificare sursă]Studiul rețelelor neurale a cunoscut perioade în care activitatea de cercetare a fost extrem de intensă și perioade în care acesta domeniu de cercetare a fost declarat complet „mort”, pentru ca apoi să revină în centrul atenției, atât în rândul cercetătorilor cât și a publicului larg prin multitudinea de aplicații practice pe care le au sau le pot avea.

Primi pași au fost făcuți la sfârșitul secolului al XIX-lea și începutul secolului al XX-lea, de către Hermann von Helmholz, Ernst Mach și Ivan Pavlov care au emis teorii asupra procesului de învățare, asupra condiționării, etc. Aceste teorii nu au adus nici un fel de modele matematice și nu se putea vorbi încă de un început. Adevăratul punct de pornire al acestui domeniu se situează la începtul anilor 1940 când Warren McCulloch și Walter Pitts au pus în evidență primul model formal al neuronului, evidențiind capacitatea de calcul a acestuia și posibilitatea de implementare cu ajutorul circuitelor electronice. Cei doi au oferit o primă abstractizare matematică a neuronului. Astfel:

- Sinapsele pe care un neuron le făcea prin dendrite cu alți neuroni au devenit intrări;

- Corpul neuronului a devenit un sumator și o funcție de activare (numită și funcție de TRANSFER)

- Axonul a devenit ieșirea

- Pentru a reprezenta caracteristici neliniare simple s-a introdus noțiunea de bias

Pe la sfârșitul anilor 1940, Hebb, având la bază teoriile lui Pavlov, a enunțat principiul adaptării permeabilității sinaptice conform căruia de fiecare dată când o conexiune sinaptică este folosită, permeabilitatea ei crește. Acest principiu stă la baza procesului de învățare prin modificarea ponderilor sinaptice.

În anii 1950 apare și prima aplicație practică, Frank Rosenblatt realizează o implementare hard, numită perceptron, utilizată în recunoașterea caracterelor. Tot în anii 1950 Bernard Windrow și Ted Hoff dezvoltă algoritmi de învățare pentru rețele neurale liniare cu un singur nivel de unități funcționale. Algoritmii lor sunt bazați pe minimizarea erorii pe setul de date de antrenare. În anul 1969 Marvin Minsky și Seymor Papert publică cartea "Perceptrons" care pune în evidență limitările la care sunt supuse rețelele neurale cu un singur nivel de unități funcționale. Acesta părea a fi sfârșitul rețelelor neurale. Publicarea acestui material, corelată cu lipsa unor echipamente de calcul digital suficient de puternice, face ca o mare parte din companiile care investeau în cercetările din acest domeniu să se reorienteze, iar o mare parte dintre cercetători își abandonează studiul în această direcție.

Anii 1970 sunt mult mai liniștiți și doar câțiva cercetători mai sunt cu adevărat activi în domeniu. Printre ei merită amintiți Teuvo Kohonen, Sames Anderson precum și Stephen Grossberg (foarte activ în cercetarea rețelelor cu auto-organizare).

Anii 1980 aduc, pe lângă noi descoperiri în domeniul rețelelor neurale, și calculatoare digitale mai puternice capabile să ajute cercetătorii în demersurile lor. Astfel că la începutul anilor 1980, odată cu o nouă abordare a rețelelor folosind formalismul fizicii statistice prin punerea în evidență a analogiei între rețelele recurente (destinate memorării asociative) și sistemele de spini magnetici propusă de John Hopfield se marchează începutul unei noi perioade de interes în domeniu, caracterizată prin extinderea domeniilor de aplicabilitate și volumul mare de implementări soft și hard folosite în aplicațiile practice.

Note

[modificare | modificare sursă]- ^ Denumire folosită în cursurile universitare de specialitate de la Florea, Adina. „Rețele neurale, slide-uri de curs pentru Sisteme de Programe pentru Timp Real”. Facultatea de Automatică și Calculatoare, Universitatea Politehnica din București.

Bibliografie

[modificare | modificare sursă]- Ciocoiu Iulian, Rețele neurale artificiale, ISBN 973-8173-16-7

- Daniela Zaharie, Curs Retele neurale Arhivat în , la Wayback Machine.

- Ben Krose and Patrick van der Smagt, An introduction to Neural Network, Amsterdam, 1996, University of Amsterdam

- Nikola K. Kasabov, Foundation of Neural Networks, Fuzzy systems, and Knowledge Engineering, Cambridge, The MIT Press, 1998

- Bernard Widrow and Michael A. Lehr, 30 Years of adaptive neural networks: Perceptron, Madaline, and Backpropagation, Proceedings of the IEEE, vol. 78 no.9,September 1990

- Dave Anderson and George McNeill, Artificial Neural Networks Technology, Kaman Sciences Corporation, 1992, New York

- Dumitrescu, D., Costin, H., Retele neurale; teorie si aplicatii, Teora, Bucuresti, 1996.

- Alin Brindusescu, Notiuni introductive

- Ștefănescu Marian, Introducere în rețele neuronale - Teorie și aplicații